𝗖𝗶𝗿𝗰𝘂𝗹𝗮𝗿 𝗘𝘅𝘁𝗲𝗿𝗻𝗮 𝟬𝟬𝟮 𝗱𝗲 𝟮𝟬𝟮𝟲 𝗧𝗿𝗮𝘁𝗮𝗺𝗶𝗲𝗻𝘁𝗼 𝗱𝗲 𝗱𝗮𝘁𝗼𝘀 𝗽𝗲𝗿𝘀𝗼𝗻𝗮𝗹𝗲𝘀 𝗰𝗼𝗻 𝗳𝗶𝗻𝗲𝘀 𝗽𝗼𝗹𝗶́𝘁𝗶𝗰𝗼𝘀 𝗼 𝗲𝗹𝗲𝗰𝘁𝗼𝗿𝗮𝗹𝗲𝘀, 𝗲𝗻 𝗲𝘀𝗽𝗲𝗰𝗶𝗮𝗹 𝗹𝗼𝘀 𝗿𝗲𝗹𝗮𝗰𝗶𝗼𝗻𝗮𝗱𝗼𝘀 𝗰𝗼𝗻 𝗮𝗰𝘁𝗶𝘃𝗶𝗱𝗮𝗱𝗲𝘀 𝗱𝗲 𝗽𝘂𝗯𝗹𝗶𝗰𝗶𝗱𝗮𝗱, 𝗺𝗮𝗿𝗸𝗲𝘁𝗶𝗻𝗴 𝗼 𝗽𝗿𝗼𝘀𝗽𝗲𝗰𝗰𝗶𝗼́𝗻 𝗽𝗼𝗹𝗶́𝘁𝗶𝗰𝗮 𝘆 𝗲𝗹𝗲𝗰𝘁𝗼𝗿𝗮𝗹.

enero 19, 2026

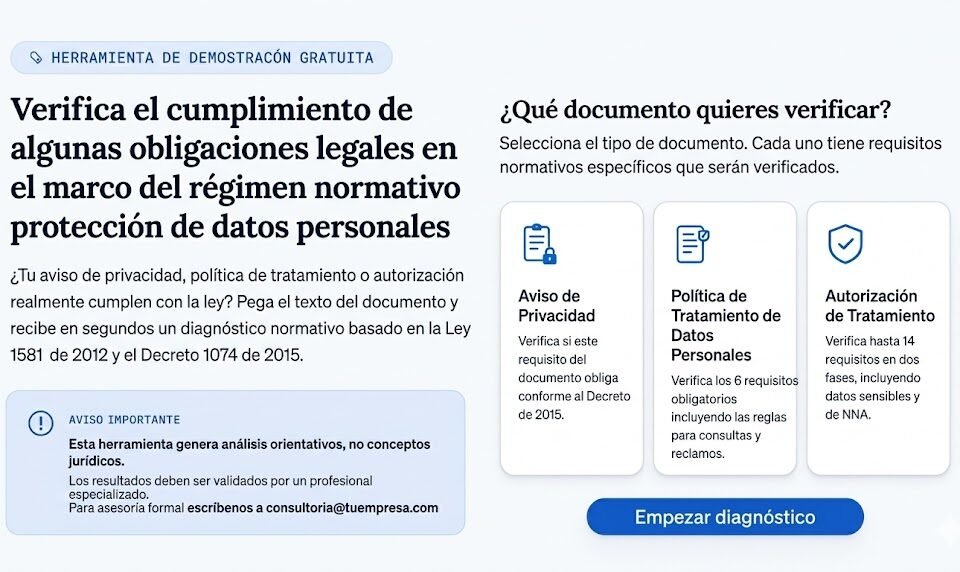

Verificador de cumplimiento en protección de datos personales

abril 7, 2026Llevamos años conversando sobre la anonimización como si fuera una solución técnica efectiva. Sin embargo, cuando se observa detenidamente, lo que aparece es un conjunto de problemas que el derecho de protección de datos personales todavía no sabe cómo resolver.

La anonimización elimina de forma irreversible todos los elementos que permiten identificar a una persona. Cuando esta es efectiva, esos datos salen del ámbito de la normativa de protección de datos. La seudonimización, en cambio, reemplaza identificadores directos por códigos o seudonimos pero conserva la posibilidad de revertir el proceso. Bajo el RGPD y bajo nuestra Ley 1581 de 2012, los datos seudonimizados siguen siendo datos personales. No obstante, la anonimización tiene diferentes problemas. Algunos de estos son:

Problema 1. Sin titular de los datos personales pero con consecuencias colectivas. Cuando los datos personales se consideran correctamente anonimizados, el régimen de protección de datos no cubre dichos datos. Eso significa que no existe obligación de informar al titular, no hay ejercicio de derechos de los titulares, no hay restricciones de finalidades del tratamiento, y tampoco, aplicación de los principios del tratamiento de datos. Entre tanto, esos mismos datos se pueden usar para segmentar poblaciones por comportamiento o riesgo, personalizar ofertas comerciales, ajustar precios según características inferidas, diseñar campañas hipersegmentadas, alimentar sistemas de scoring para acceso a crédito, empleo o seguros. Es decir, esos datos se utilizan para toma de decisiones que afectan a personas reales, pero se fundamentan en datos que jurídicamente ya no son personales. Esto es una de las paradojas más complejas del ecosistema de datos actual, debido a que el derecho de la protección de datos personales queda sin aplicación en escenarios en que el poder sobre las personas se ejerce con mayor intensidad.

Problema 2.El negocio detrás de la anonimización.Muchas organizaciones no anonimizan solo porque sea buena para la ciencia o las estadísticas. En muchos de los casos, se realiza principalmente porque los datos anonimizados pueden usarse con mucha mayor libertad y eso tiene un valor económico enorme. Pensemos en un conjunto de datos de pacientes debidamente anonimizado puede entrenar modelos predictivos de salud. Hasta ahí, nadie discute. Pero esos mismos datos pueden monetizarse de formas que van mucho más allá de la finalidad original, sin que el titular tenga ningún mecanismo de control ni conocimiento de lo que ocurre. El proceso de anonimización se convierte así en una llave que abre la puerta a usos que, bajo datos identificados, serían inviables jurídicamente. La Comisión Europea propuso en su momento en el Omnibus Digital modificar el artículo 4(1) del RGPD para excluir los datos seudonimizados del concepto de dato personal. El Comité Europeo de Protección de Datos y el Supervisor Europeo respondieron con una Opinión Conjunta y la propuesta fue retirada. Pero que haya llegado tan lejos no es una consideración menor.

Problema 3. La inferencia como daño invisible. En la reidentificación alguien cruza datos y descubre quién eres. Pero la inferencia es diferente. Los sistemas de aprendizaje automático pueden deducir atributos sensibles como: el estado de salud, la orientación sexual, la situación financiera, el comportamiento de consumo, a partir de datos que no te identifican y que técnicamente cumplen todos los estándares de anonimización vigentes. El sistema no descubre quién eres. Deduce cosas sobre ti y actúa en consecuencia. Ojo, ese daño es probabilístico, no es individual, porque no hay un titular identificado al que se le haya vulnerado un dato en concreto. Hay es una persona sobre la que se tomó una decisión, ya sea, negarle un crédito, subirle una prima de seguro, excluirla de una oferta laboral basada en un perfil inferido a partir de datos que jurídicamente no existen, como son los personales. Entonces, en este caso, el derecho de protección de datos, tal como está diseñado, no tiene categoría para considerar ese daño.

Problema 4. Lo que hoy es anónimo, mañana no lo es. La anonimización depende de una condición temporal que a su vez depende del estado del arte en capacidades de reidentificación y ese estado avanza de manera constante. Hace poco, investigadores de ETH Zurich y Anthropic publicaron un estudio en el cual, usando únicamente modelos de lenguaje de gran escala con acceso a internet, lograron reidentificar usuarios pseudónimos con un 67% de efectividad y 90% de precisión a partir de texto no estructurado, por un costo de entre uno y cuatro dólares por perfil. Lo que antes requería horas de trabajo de un investigador dedicado, hoy lo hace un agente autónomo en minutos. El cambio que se genera, es por temas de costos, no solo por capacidad, en este caso, el costo de reidentificar cae a casi cero. Esto tiene diferentes implicaciones, entre otras, que el modelo de riesgo sobre el que se construyó toda la lógica de la anonimización necesita un cambio. Referencia: Lermen et al. (2026). Large-scale online deanonymization with LLMs. arXiv:2602.16800 https://arxiv.org/abs/2602.16800

Problema 5. La relación responsable-encargado y el cambio de finalidad.Este problema me parece especialmente relevante, y lo veo todo el tiempo, en ciertos sectores económicos. Un responsable del tratamiento anonimiza su base de datos y se la transfiere a un encargado para que entrene modelos o realice análisis. Como los datos están anonimizados, el responsable considera que ha salido del régimen de protección de datos y que no hay tratamiento que declarar, ni finalidad que justificar, ni autorización que obtener. Aunque también se presenta otra variante: el encargado anonimiza datos que le ha sumistrado el responsable para entrenar sus modelos. El problema es que ese encargado, con las capacidades que documenta el estudio anterior, puede reidentificar a los titulares. Y cuando lo hace o cuando simplemente infiere atributos sensibles sobre ellos sin reidentificarlos formalmente está realizando un tratamiento de datos personales que el responsable original nunca conoció, que los titulares nunca autorizaron, y que probablemente es incompatible con la finalidad que justificó la recolección original.

Entonces: ¿Quién responde? ¿El responsable que transfirió datos que consideraba anónimos? ¿El encargado que los reidentificó? ¿Hay un cambio de finalidad encubierto? ¿Hay un tratamiento no autorizado? Pueda que el marco jurídico actual, no tenga respuestas claras para ninguna de estas preguntas.

Problema 6. Diseñado para uno, aplicado sobre todos. El derecho de protección de datos está diseñado para proteger a personas individuales determinadas (identificadas) o determinables (identificables). Si hay un titular, hay un dato, hay un responsable, hay derechos que ejercer. Pero el perfilamiento algorítmico opera sobre colectivos, sobre categorías, sobre probabilidades. Los efectos no recaen sobre un individuo identificado recaen sobre todos los que comparten ciertos atributos inferidos. Una persona no sabe que fue excluida de una oferta porque el modelo la clasificó en una categoría de riesgo construida a partir de datos de miles de personas anónimas. No hay titular identificado. No hay dato personal vulnerado. No hay derecho que ejercer. El núcleo del problema no es solo la posible reidentificación, es que el paradigma individualista del derecho de protección de datos es insuficiente para abordar impactos colectivos derivados del tratamiento masivo de datos. Y hasta que no tengamos categorías jurídicas nuevas para los daños grupales y probabilísticos, esa brecha va a seguir siendo explotada.

Problema 7. El silencio normativo colombiano. Todo lo anterior ocurre en un ecosistema jurídico que en Colombia tiene 13 años sin actualización sustantiva. El literal c, del artículo 3 de la Ley 1581 de 2012 define el dato personal como «cualquier información vinculada o que pueda asociarse a una o varias personas naturales determinadas o determinables» La anonimización aparece en el artículo 6 como mecanismo habilitante para el tratamiento de datos sensibles con fines históricos, estadísticos o científicos siempre que se adopten «las medidas conducentes a la supresión de identidad de los titulares».El Decreto 1081 de 2015 (art. 2.1.1.4.3.2.) reconoce la anonimización como herramienta para permitir acceso a información pública sin revelar apartes reservados o clasificados, pero la norma no establece estándares técnicos, no exige evaluaciones de riesgo de reidentificación, no distingue entre técnicas, no regula la relación entre responsables y encargados cuando los datos se «anonimizan» para transferir, no contempla la inferencia como categoría de riesgo, no exige que la evaluación sea dinámica. Mejor dicho, no tiene respuesta para ninguno de los seis problemas anteriores.

Anonimizar además de eliminar la identidad, también es administrar probabilidades en un entorno que cambia más rápido que el derecho. Y cuando esas probabilidades permiten perfilar, inferir, segmentar y decidir sobre personas reales sin que el ordenamiento jurídico tenga herramientas para responder, la discusión deja de ser técnica. El derecho que necesitamos todavía no existe. ¿Lo estamos construyendo?